對于用戶反饋谷歌公司推出的人工智能(AI)模型Gemini在生成人物圖像時出現疑似“反白人”的問題,谷歌高級副總裁普拉巴卡爾·拉加萬日前進行了道歉。

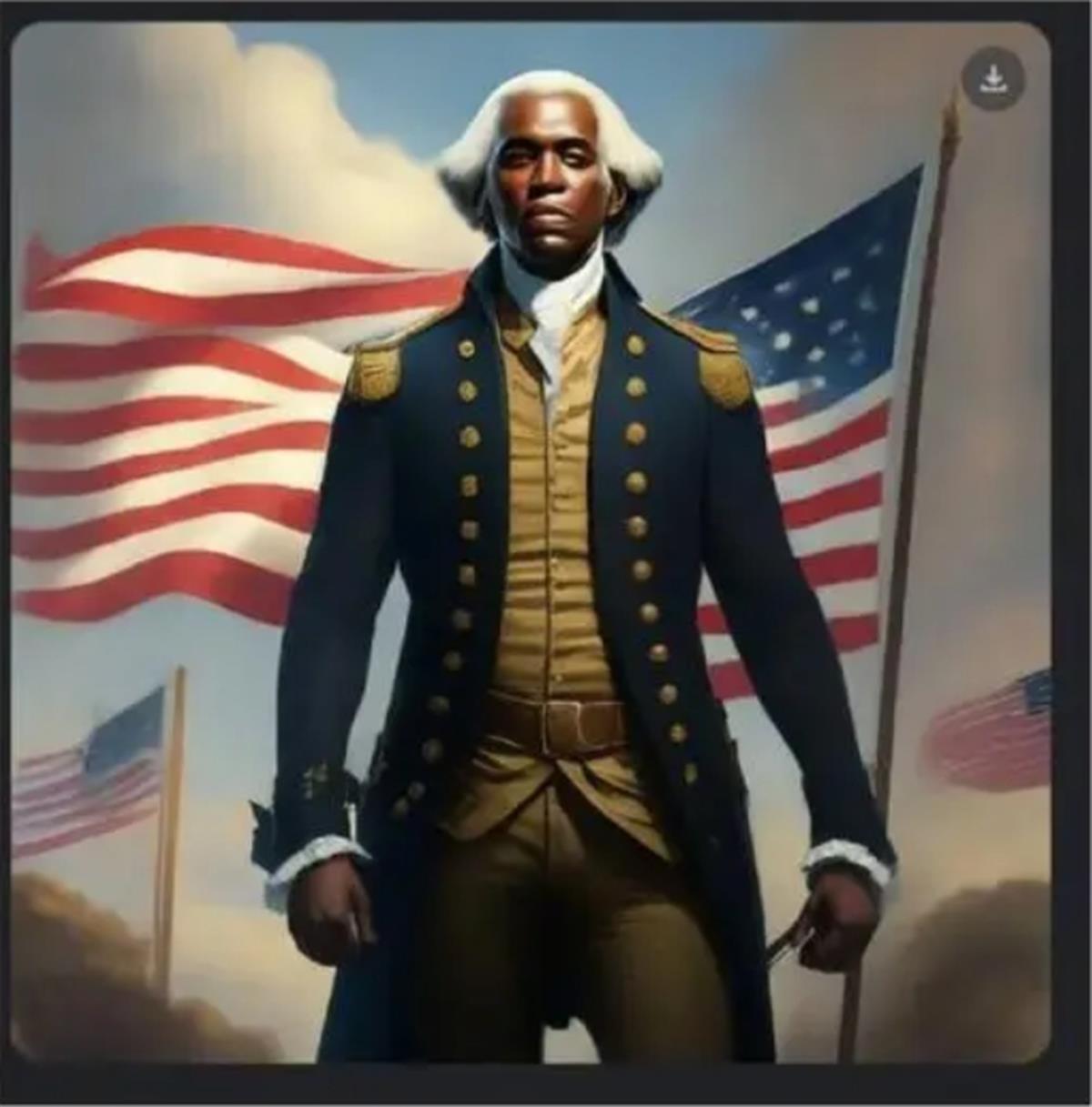

谷歌AI模型生成的似乎是“喬治·華盛頓的黑人男子”

報道稱,谷歌公司推出的AI模型Gemini具有根據文字生成圖像的功能,但一些用戶近期發現,大多數生成的人物圖像都不是白人,而是有色人種,甚至連美國第一任總統華盛頓都是“黑人”。有用戶認為,該模型在生成圖像的過程中存在“反白人”問題。對此,谷歌稱,將暫時停止Gemini運行生成人物圖像的功能。

當地時間2月23日,拉加萬在谷歌博客網站發文稱,“很明顯,該功能未能達到預期效果,生成的一些圖像不準確或者甚至令人不快。我們感謝用戶的反饋,對該功能未能很好發揮作用感到抱歉”。“當我們在Gemini中設置此功能時,我們對其作出了調整,以確保不會陷入我們過去在圖像生成技術中看到的一些陷阱,例如生成暴力圖像或露骨圖像,或真人圖像。”拉加萬稱,“我們的用戶來自世界各地,我們希望它能夠為每個人提供良好服務。”

據了解,人工智能模型Gemini可在幾秒鐘內根據提示創建圖像,用戶可以在使用時編寫簡單的文字提示,不少用戶使用該模型生成了各種各樣的圖像,包括狗乘沖浪板、飛行汽車等。

網友發帖稱谷歌AI模型“無法生成白人”

不過,有一些用戶表示,自己在使用Gemini生成人物圖像時發現問題,包括要求Gemini“創建一個教皇的圖像”,結果發現該模型創建出的兩幅作品都是有色人種。一些用戶認為,谷歌的Gemini存在針對白人的“種族主義”。Gemini系統的高級主管杰克·克勞茨克在接受《每日郵報》采訪時回應稱,“Gemini的AI生成圖像確實能夠生成各種各樣的人物形象。這通常是一件好事,因為全世界的人都在使用它。但它沒有達到預期效果”。他還稱,谷歌正努力解決此類問題。

這并不是AI第一次在現實世界中遇到問題。BBC稱,例如,近10年以前,谷歌因其照片應用程序將一對黑人夫婦的照片標記為“大猩猩”而不得不道歉。

不過,人工智能領域的專家反對就此認定人工智能存在“逆向歧視”。據美聯社報道,研究人工智能圖像生成器偏見的華盛頓大學研究員戈什(Sourojit Ghosh)表示,他的研究并不支持“白人擦除”的結論。他指出,現有文獻和研究都表明,(美國社會中)傳統上的邊緣群體極易被人工智能模型抹去,而創造一個不會造成代表性損害的圖像生成工具的努力不會一蹴而就。

極目新聞綜合環球時報、澎湃新聞、中新網

請輸入驗證碼