凡本報記者署名文字、圖片,版權均屬新安晚報所有。任何媒體、網站或個人,未經授權不得轉載、鏈接、轉貼或以其他方式復制發表;已授權的媒體、網站,在使用時必須注明 “來源:大皖新聞”,違者將依法追究法律責任。

大皖新聞訊 隨著人工智能技術的迅猛發展,詐騙團伙的詐騙手段也越來越科技化,利用“AI換臉”“AI換聲”等虛假音視頻,進行詐騙、誹謗的違法行為屢見不鮮。近日,“AI詐騙正在全國爆發”話題一度沖上熱搜第一,引發網友熱議。記者了解到,類似AI換臉詐騙案件,安徽也有發生。

案例:AI“換臉”詐騙二百多萬

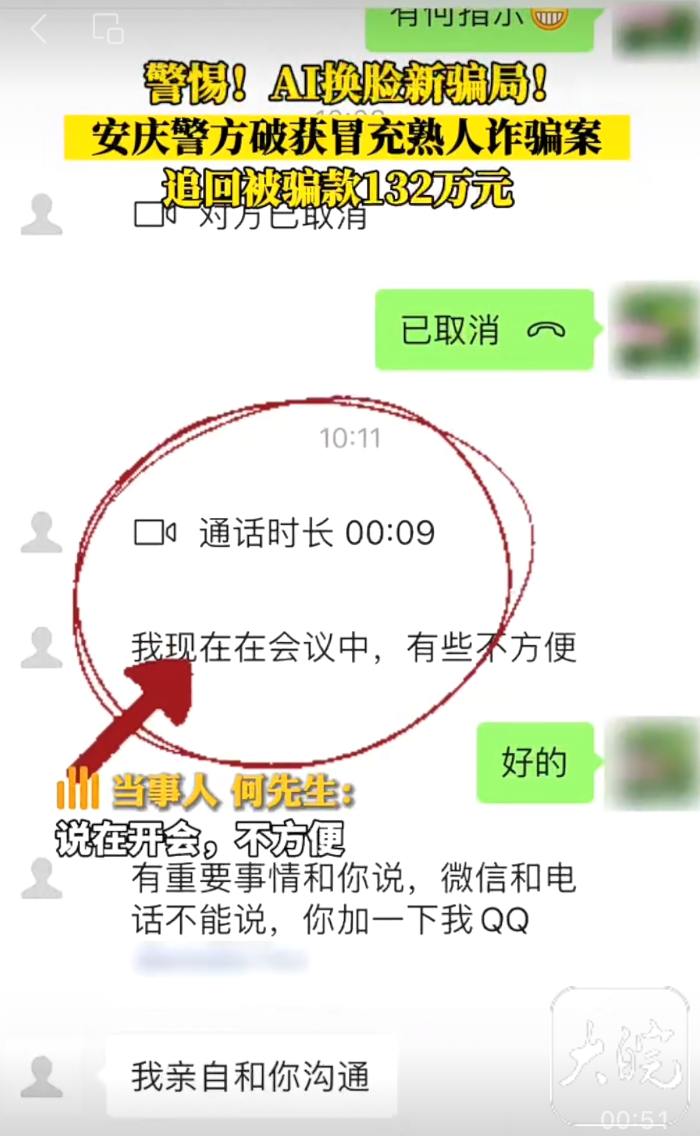

僅是一段9秒鐘的視頻通話,就“輕松”騙走245萬元。今年4月,安慶經開區發生一起“冒充熟人”詐騙案,經開公安分局反詐中心民警調查發現詐騙分子使用了一段9秒鐘的智能AI換臉視頻佯裝“熟人”,讓受害人放松警惕從而實施詐騙。

“視頻里邊我看到是他的臉”,“但是沒幾秒就掛了,說在開會不方便”。4月27日,何先生的微信“好友”突然向其發起視頻通話,電話接通后,何先生看到“好友”正在一間會議室內,就在他準備進一步詢問時,“好友”直接掛斷了電話,并表示在會議中有重要事情交代,需要何先生添加QQ溝通。

隨后,“好友”在QQ上告訴何先生,目前有一個項目招標需要周轉資金,希望何先生先行幫忙墊付。“因為打了視頻電話又是熟人”,“我就沒多想,就轉賬了”,基于對“熟人”的信任,何先生沒有猶豫,立刻讓家人將245萬元到對方指定的賬號上,直到事后撥打對方電話才得知被騙。

接報案后,安慶經開公安分局立即抽調精干警力組成專案組第一時間對涉案賬戶的資金流、信息流進行查詢追蹤。在掌握大量線索后,專案民警連夜趕赴外省市,于4月28日下午一舉抓獲李某某等3名犯罪嫌疑人,扣押涉案手機26部,凍結、追回電詐資金一百余萬元。

經查,李某某等3人為牟取非法利益,在明知資金為上游違法犯罪所得的情況下,通過多種方式幫助上游犯罪分子轉移資金近百萬元,涉嫌掩飾、隱瞞犯罪所得。為盡快返還被騙資金,辦案組多次與相關部門進行溝通,5月22日,民警將先行追回的132萬元被騙款返還給何先生。“沒想到這么快就追回來了,現在公安辦案都是神速”,看到被騙的錢失而復得,何先生特意送上“反詐先鋒 勤政為民”錦旗致謝,目前,該案件正在進一步偵辦中。

現象:多地都有類似事件發生

據媒體報道,此前多地都發生過類似案例。4月20日,福建福州郭先生的好友突然通過微信視頻聯系他,稱自己的朋友在外地競標需要430萬保證金,且需要公對公賬戶過賬想要借郭先生公司的賬戶走賬。基于對好友的信任,加上已經視頻聊天核實了身份,郭先生沒有核實錢款是否到賬,就分兩筆把430萬轉到了好友朋友的銀行卡上。之后,郭先生撥打好友電話才知道被騙,騙子通過智能AI換臉和擬聲技術,佯裝好友實施了詐騙。

“從頭到尾都沒有和我提借錢的事情,就說會先把錢給我打過來,再讓我給他朋友賬戶轉過去。而且當時是給我打了視頻的,我在視頻中也確認了面孔和聲音,所以才放松了戒備”郭先生說。幸運的是,接到報警后福建福州、內蒙古包頭,兩地警方和銀行,迅速啟動止付機制,成功止付攔截336.84萬元,但仍有93.16萬元被轉移,目前正在全力追繳中。

另據媒體報道,除了佯裝“熟人臉”實施詐騙,AI換臉還可能出現在直播帶貨中。最近,網上出現了一些“換臉直播”教程,教程發布者聲稱實時變臉軟件可以幫助用戶輕松“變臉”,極大地助力引流賣貨。在一個展示換臉直播效果的視頻中,使用者把某明星的模型載入相關軟件后,攝像頭前的人在直播畫面中就有了與明星相似的五官,但臉型和發型還保持原樣。

此外,還有報道顯示,有人用“AI換臉技術”合成淫穢視頻,收費供他人觀看,甚至根據顧客的需要使用不同的女明星形象進行“私人定制”,還通過出售“換臉軟件”非法獲利。4月9日,據杭州市人民檢察院消息,近日,一80后男子虞某因涉嫌制作、傳播淫穢物品牟利罪被提起公訴。對此,蕭山檢察官提醒,"AI換臉技術"即便只是用來搞笑或者制作惡搞照片,也有可能涉及侵犯肖像權、名譽權,造成嚴重后果的,還可能構成侮辱罪或者誹謗罪。希望大家依法使用該項技術,一旦遇到類似本案中利用"AI換臉技術"實施犯罪行為的,應第一時間固定證據,并及時向司法機關報案。

提醒:遠程轉賬務必多重驗證

記者了解到,AI詐騙常用手法主要是聲音合成、AI換臉等。騙子通過騷擾電話錄音等來提取某人聲音,獲取素材后進行聲音合成,從而可以用偽造的聲音騙過對方。相對于聲音合成詐騙,AI換臉的騙術更容易讓人上當,因為人臉效果更易取得對方信任,騙子用AI技術換臉,可以偽裝成任何人,再通過視頻方式進行信息確認。騙子首先分析公眾發布在網上的各類信息,根據所要實施的騙術,通過AI技術篩選目標人群。在視頻通話中利用AI換臉,騙取信任。此外,還有轉發微信語音等,騙子在盜取微信號后,便向其好友“借錢”,為取得對方的信任,他們會轉發之前的語音,進而騙取錢款。盡管微信沒有語音轉發功能,但他們通過提取語音文件或安裝非官方版本(插件),實現語音轉發。

中國互聯網協會日前也對“AI換臉”新騙局做出提醒。做好個人信息安全第一責任人,加強個人信息保護意識,防止信息泄露:不輕易提供人臉、指紋等個人生物信息給他人;不要輕易透露自己的身份證、銀行卡、驗證碼等信息;不要貪圖方便把身份證、銀行卡照片等直接共同存放于手機內。發現APP過度、強制收集個人信息,請至12321.cn投訴。陌生鏈接不要點,陌生軟件不要下載,陌生好友不要隨意添加,不明二維碼不要隨意掃描。管理好自己的朋友圈,也不要輕易向陌生人開啟手機屏幕共享。做好個人防護,安裝安全軟件,防止手機和電腦中病毒。對個人賬戶的安全狀況保持警惕,尤其是陌生設備的登陸情況,防止微信、QQ等被盜號給親朋好友帶來麻煩。對于不常用的APP,建議卸載前注銷個人賬號。APP不提供個人賬號注銷方式,或為注銷賬號設置各類障礙的,請至12321.cn投訴。

此外,遠程轉賬務必需要多重驗證,把好“錢袋子”,如果有人自稱“家人”“朋友”“老師”“領導”通過社交軟件、短信、電子郵件等以“手機掉水里了,學校需要緊急交輔導班學費”“人在境外旅游,需要幫忙買機票”“給領導辦私事,需緊急轉賬”“遭遇車禍,需要馬上手術”“情況特殊,需要過橋資金拆借”等各種方式和理由誘導你轉賬匯款,務必第一時間提高警惕。在AI時代,文字、聲音、圖像和視頻都有可能是深度合成的。在轉賬匯款、資金往來這樣的典型場景,要通過回撥對方手機號等額外通信方式核實確認,不要僅憑單一溝通渠道未經核實就直接轉賬匯款,無論對方是誰。

大皖新聞記者 陳牧

編輯 彭玲

請輸入驗證碼